Της Γαρυφαλλιάς Σόλια,

Η Ευρωπαϊκή Ένωση, στο πλαίσιο της ψηφιακής της στρατηγικής, έχει θέσει σε εφαρμογή ένα σύγχρονο ρυθμιστικό πλαίσιο. Στόχος, η διασφάλιση της υπεύθυνης ανάπτυξης και χρήσης της Τεχνητής Νοημοσύνης, προς όφελος των πολιτών και της κοινωνίας στο σύνολό της.

Στην Ευρωπαϊκή Ένωση

Τον Απρίλιο του 2021 προτάθηκε από την Ευρωπαϊκή Επιτροπή (European Commission) το πρώτο ευρωπαϊκό νομικό πλαίσιο για την τεχνητή νοημοσύνη (EU regulatory framework for AI). Η νομοθετική πράξη για την τεχνητή νοημοσύνη (AI Act) είναι ένας κανονισμός, ο οποίος έχει συμφωνηθεί να αποτελέσει ευρωπαϊκό νόμο.

Για να διασφαλιστεί η ορθή εφαρμογή του νόμου, έχουν συσταθεί διάφορα διοικητικά όργανα:

- Γραφείο για την Τ.Ν. εντός της Επιτροπής για την επιβολή των κοινών κανόνων σε ολόκληρη την Ε.Ε.

- Μια επιστημονική ομάδα ανεξάρτητων εμπειρογνωμόνων για την υποστήριξη των δραστηριοτήτων επιβολής

- Ένα συμβούλιο για την Τ.Ν. με εκπροσώπους των κρατών-μελών για να συμβουλεύει και να βοηθά την Επιτροπή και τα κράτη-μέλη στη συνεπή και αποτελεσματική εφαρμογή της πράξης για την Τ.Ν.

- Ένα συμβουλευτικό φόρουμ για τα ενδιαφερόμενα μέρη που θα παρέχει τεχνική εμπειρογνωμοσύνη στο συμβούλιο για την Τ.Ν. και στην Επιτροπή.

Σκοπός του Ευρωκοινοβουλίου είναι να βεβαιωθούμε ότι η ανάπτυξη και χρήση συστημάτων Τ.Ν. στην Ε.Ε. να έχουν τα εξής χαρακτηριστικά: είναι ασφαλή, διαφανή, ανιχνεύσιμα, χωρίς διακρίσεις και φιλικά προς το περιβάλλον. Τα συστήματα Τ.Ν. θα πρέπει να επιβλέπονται από ανθρώπους και όχι από αυτοματισμούς, για την πρόληψη επιβλαβών αποτελεσμάτων.

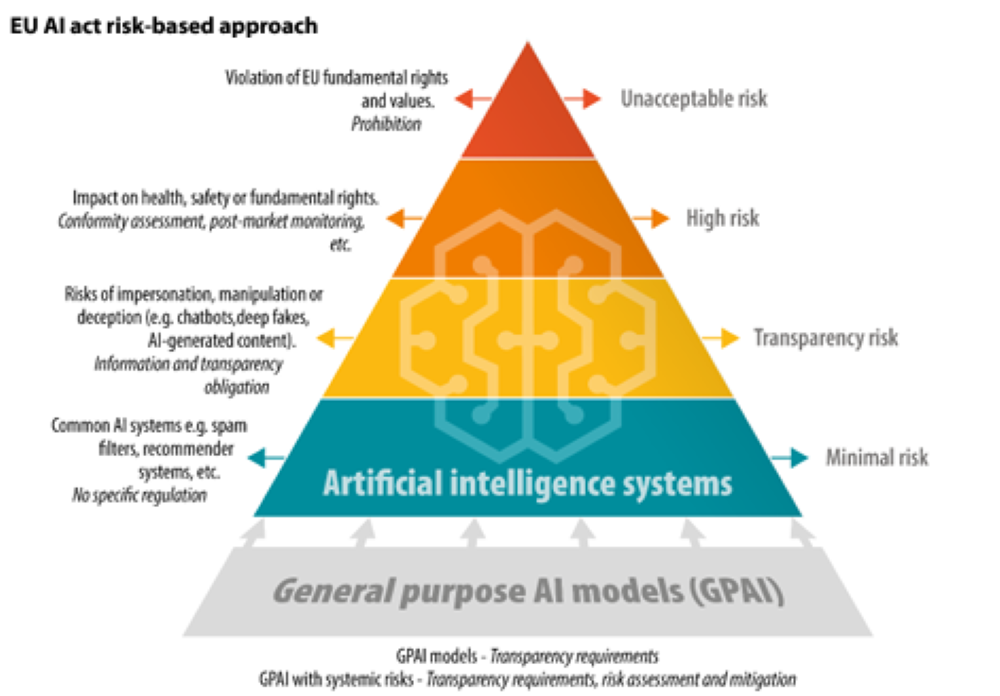

Η νομική προσέγγιση που ακολουθεί η Ε.Ε. γίνεται με την αξιολόγηση κινδύνου των συστημάτων, όσο αυξάνεται το ρίσκο αυξάνονται και οι νομικοί περιορισμοί. Η κατηγοριοποίηση των συστημάτων είναι η ακόλουθη:

- Μη αποδεκτό ρίσκο (Unacceptable risk): Πρόκειται για συστήματα που θεωρούνται επικίνδυνα για τον άνθρωπο και απαγορεύονται. Περιλαμβάνει ένα σύνολο συγκεκριμένων λειτουργιών όπως η παρακολούθηση συμπεριφοράς, εκμετάλλευση ευάλωτων ομάδων, συστήματα βιομετρικής κατηγοριοποίησης και profiling. Σε περιπτώσεις όπως το profiling και των συστημάτων βιομετρικής κατηγοριοποίησης έχει χρησιμοποιηθεί η τεχνική του predictive policing για τον εντοπισμό πιθανών επιπτώσεων από τη χρήση αυτού του τύπου εφαρμογών.

- Υψηλού κινδύνου (High risk): Αφορά συστήματα που επηρεάζουν αρνητικά την ασφάλεια, την υγεία ή τα θεμελιώδη δικαιώματα των πολιτών, θα θεωρούνται υψηλού κινδύνου και θα χωρίζονται σε δύο κατηγορίες:

α) Συστήματα τεχνητής νοημοσύνης που χρησιμοποιούνται σε προϊόντα που εμπίπτουν στη νομοθεσία της Ε.Ε. για την ασφάλεια των προϊόντων. Αυτό περιλαμβάνει παιχνίδια, αεροπορία, αυτοκίνητα, ιατρικές συσκευές και ανελκυστήρες.

β) Συστήματα τεχνητής νοημοσύνης που εμπίπτουν σε οκτώ συγκεκριμένους τομείς που θα πρέπει να καταχωρηθούν σε μια βάση δεδομένων της Ε.Ε.:

- Βιομετρική αναγνώριση και κατηγοριοποίηση φυσικών προσώπων

- Διαχείριση και λειτουργία υποδομών ζωτικής σημασίας

- Εκπαίδευση και επαγγελματική κατάρτιση

- Απασχόληση, διαχείριση εργαζομένων και πρόσβαση στην αυτοαπασχόληση

- Πρόσβαση και απόλαυση βασικών ιδιωτικών υπηρεσιών και δημόσιων υπηρεσιών και παροχών

- Επιβολή του νόμου

- Διαχείριση μετανάστευσης, ασύλου και ελέγχου των συνόρων

- Βοήθεια στη νομική ερμηνεία και εφαρμογή του νόμου.

Απαιτεί την αξιολόγηση αυτών των συστημάτων για την εισαγωγή τους στην αγορά, αλλά και καθ’ όλη τη διάρκεια του κύκλου ζωής αυτών των συστημάτων.

- Περιορισμένου κινδύνου/κίνδυνος ως προς τη διαφάνεια (Limited risk/ Transparency risk): Τα συστήματα αυτά υπόκεινται σε απαιτήσεις πληροφόρησης και διαφάνειάς. Ο χρήστης πρέπει να γνωρίζει ότι αλληλοεπιδρά με ένα σύστημα Τ.Ν. και να αποφασίσει αν θέλει να συνεχίσει να το χρησιμοποιεί. Περιλαμβάνει συστήματα Τ.Ν. που παράγουν ή χειρίζονται περιεχόμενο εικόνας, ήχου ή βίντεο, για παράδειγμα deepfakes.

- Ελάχιστου κινδύνου (minimal/no-risk): Περιλαμβάνονται τα συστήματα που δεν εμπίπτουν στις 3 παραπάνω κατηγορίες. Αφορά συστήματα που έχουν μειωμένες απαιτήσεις ως προς τη διαφάνεια.

Ο κανονισμός προβλέπει, επίσης, ειδικούς κανόνες για τα μοντέλα Τ.Ν. γενικού σκοπού (GPAI). Αξίζει να σημειωθεί ότι για την κατηγορία των GPAI που θα μπορούσαν να προκαλέσουν συστημικό κίνδυνο (systemic risk), δηλαδή έχουν σημαντικό αντίκτυπο στην εσωτερική αγορά, έχουν θεσπιστεί αυστηρότερες απαιτήσεις.

Επιπλέον, η Ε.Ε. επιβάλει σε εθνικό επίπεδο τη δημιουργία τουλάχιστον ενός ρυθμιστικού sandbox για να διευκολύνουν την ανάπτυξη και τη δοκιμή καινοτόμων συστημάτων Τ.Ν. Το ρυθμιστικό sandbox για την Τ.Ν. επιτρέπει, κατά περίπτωση, τη δοκιμή συστημάτων Τ.Ν. σε πραγματικές συνθήκες εκτός εργαστηρίου για περιορισμένο χρονικό διάστημα (με την προϋπόθεση της συμμόρφωσης με τους κανόνες και τις αρχές της νομοθεσίας της Ε.Ε. για την προστασία των δεδομένων).

Στην περίπτωση μη συμμόρφωσης, τα πρόστιμα για τις παραβάσεις καθορίζονται ως ποσοστό του συνολικού ετήσιου κύκλου εργασιών της εταιρείας παραβάτη κατά το προηγούμενο οικονομικό έτος ή ως ένα προκαθορισμένο ποσό, ανάλογα με το ποιο είναι υψηλότερο. Όσο για τις νεοσύστατες επιχειρήσεις και τις μικρομεσαίες επιχειρήσεις υπόκεινται σε αναλογικά διοικητικά πρόστιμα.

ΕΝΔΕΙΚΤΙΚΕΣ ΠΗΓΕΣ

- Artificial intelligence act BRIEFING EU Legislation in Progress, European Parliament, Tambiama Madiega ,EPRS (European Parliamentary Research Service), 2024, διαθέσιμο εδώ

- Artificial intelligence (AI) act: Council gives final green light to the first worldwide rules on AI, Council of the EU,2024, διαθέσιμο εδώ